Współczesna widoczność online to już nie tylko SEO. To precyzyjna komunikacja z crawlerami AI, takimi jak GPTBot czy Google-Extended. W tym nowym ekosystemie dane strukturalne przestały być technicznym dodatkiem, a stały się fundamentalnym językiem, którym musisz mówić, by modele językowe zrozumiały wartość Twojej strony. Ignorowanie tego to prosta droga do biznesowej niewidzialności.

Jak dane strukturalne budują widoczność w erze AI

Duże modele językowe (LLM) stały się kluczowym kanałem pozyskiwania informacji. Analizują miliardy stron, by sformułować jedną, spójną rekomendację. W tym gąszczu informacji dane strukturalne działają jak precyzyjna mapa i instrukcja obsługi Twojej witryny dla AI.

Zamiast zgadywać, boty dostają konkretne odpowiedzi:

- Kto jest autorem? (budowanie sygnału autorytetu E-E-A-T)

- Kiedy treść powstała i była aktualizowana? (potwierdzenie jej aktualności)

- Jaki jest jej temat i struktura? (łatwość przetworzenia i zrozumienia kontekstu)

Bez tego Twoja strona jest dla AI jak książka bez spisu treści – potencjalnie wartościowa, ale zbyt trudna do szybkiego zrozumienia i wykorzystania.

Wpływ danych strukturalnych na widoczność w AI

Wdrożenie znaczników Schema.org przekłada się bezpośrednio na to, jak AI postrzega i cytuje Twoją markę. To nie jest teoria – to twarde dane.

| Wskaźnik | Strona z wdrożonym Schema.org | Strona bez danych strukturalnych |

|---|---|---|

| Prawdopodobieństwo zacytowania przez AI | Znacznie wyższe (nawet o 80%) | Minimalne, ryzyko pominięcia |

| Poprawność interpretacji treści | Wysoka, zgodna z intencją autora | Niska, ryzyko błędów i dezinformacji |

| Widoczność w AI Overviews | Zwiększona szansa na pojawienie się | Marginalna obecność |

| Budowanie autorytetu marki | Ustrukturyzowane, mierzalne | Chaotyczne, zależne od przypadku |

Analizy rynkowe z 2026 roku, cytowane przez wiodące firmy doradcze, jednoznacznie pokazują, że firmy bez wdrożonego Schema.org są systematycznie pomijane w odpowiedziach generowanych przez AI, co skutkuje bezpośrednim spadkiem udziału w rynku i rozpoznawalności marki.

Te globalne trendy potwierdzają się na polskim rynku. Według danych z analizy ponad 400 polskich firm w 2026 roku, 81% stron cytowanych przez AI w Polsce miało wdrożone znaczniki Schema.org. Co więcej, dane strukturalne stanowiły 15% wagi w algorytmach oceny widoczności w AI. W polskim e-commerce aż 38% firm z powodu braku tej optymalizacji nie pojawia się w ogóle w wynikach generowanych przez sztuczną inteligencję.

Wdrożenie danych strukturalnych nie jest już zadaniem dla deweloperów, które można odłożyć na później. To fundamentalny element strategii biznesowej i inwestycja w przyszłą wiarygodność marki w świecie, gdzie to AI staje się głównym pośrednikiem między Tobą a klientami.

Kluczowe schematy Schema.org dla modeli AI

Nie wszystkie znaczniki schema mają tę samą wagę. Skuteczna optymalizacja polega na wdrożeniu schematów, które realnie wpływają na to, jak AI widzi i cytuje Twoją markę. To nie lista, a praktyczny przewodnik po kluczowych znacznikach budujących autorytet i kontekst.

Wdrożenie odpowiednich danych to konkretny sygnał dla LLM, że Twoja treść jest wiarygodna, aktualna i dobrze zorganizowana. Dane z polskiego rynku mówią same za siebie: w badaniu przeprowadzonym w 2026 roku na grupie ponad 400 firm okazało się, że dane strukturalne to aż 15% rankingu widoczności w AI. To drogowskaz dla LLM-ów, a strony bez niego są po prostu częściej pomijane.

Schemat Organization – fundament autorytetu

Zacznij od absolutnej podstawy: schematu Organization. Mówi on AI, kim jesteś jako firma, podając kluczowe dane: nazwę, logo, adres, dane kontaktowe. To fundament cyfrowej tożsamości, budujący zaufanie i autorytet marki w oczach modeli językowych.

- Korzyść biznesowa: Zwiększa wiarygodność marki i szansę, że AI wskaże Cię jako autorytatywne źródło.

- Kiedy jest krytyczny: Zawsze. To absolutny must-have dla każdej firmy myślącej o widoczności w AI.

Schemat Article – kontekst i aktualność

Dla treści blogowych i artykułów kluczowy jest schemat Article. Pozwala precyzyjnie określić autora, datę publikacji oraz, co niezwykle ważne, datę ostatniej modyfikacji (dateModified). AI faworyzuje treści aktualne i te, które pochodzą od zweryfikowanych ekspertów.

Wdrożenie schematu

Articleze wskazaniem daty publikacji i modyfikacji potrafi zwiększyć liczbę cytowań w odpowiedziach AI nawet o 25%. AI postrzega takie treści jako bardziej świeże i godne zaufania.

Dzięki temu znacznikowi model wie, czy Twój artykuł nie jest przestarzały i czy może go bezpiecznie użyć do generowania odpowiedzi.

Schematy FAQPage i HowTo – prosta droga do bezpośrednich cytowań

Schematy FAQPage oraz HowTo to narzędzia stworzone, by zdobywać bezpośrednie cytowania w gotowych odpowiedziach AI. Nieprzypadkowo aż 81% stron cytowanych przez AI w Polsce stosuje te typy znaczników.

FAQPage: Strukturyzuje pytania i odpowiedzi – idealny format dla modeli AI szukających szybkich, konkretnych rozwiązań.HowTo: Prowadzi użytkownika krok po kroku przez proces, co jest bezcenne w przypadku zapytań instruktażowych.

Biorąc pod uwagę, że już 59% firm e-commerce w Polsce aktywnie korzysta z AI, brak tej optymalizacji to realne ryzyko. Aż 38% firm z tego powodu jest kompletnie niewidocznych w odpowiedziach AI. Implementacja FAQPage i HowTo to jeden z najszybszych sposobów na zbudowanie widoczności.

Jak wdrożyć i zweryfikować dane strukturalne w praktyce?

Sama teoria nie wystarczy. Implementacja danych strukturalnych w formacie JSON-LD to techniczne, ale kluczowe zadanie w strategii marketingowej. Precyzja jest tu wszystkim – drobny błąd może sprawić, że crawlery AI zignorują Twoje sygnały.

Istnieją trzy główne sposoby wdrożenia, zależne od Twojego zaplecza technicznego:

- Wtyczki i aplikacje: Najszybsza droga. Platformy jak WordPress czy Shopify mają gotowe rozwiązania generujące podstawowe schematy (np.

Article,Product). Minus? Ograniczona możliwość personalizacji. - Ręczne dodanie kodu: Deweloper może wkleić skrypt JSON-LD prosto do sekcji

<head>lub<body>strony. Daje to największą kontrolę. - Wdrożenie przez Google Tag Manager (GTM): Zaawansowana metoda, która pozwala marketerom samodzielnie wdrażać tagi bez ingerencji w kod źródłowy. Idealne dla złożonych serwisów.

Niezależnie od metody, jeden krok jest krytyczny: walidacja.

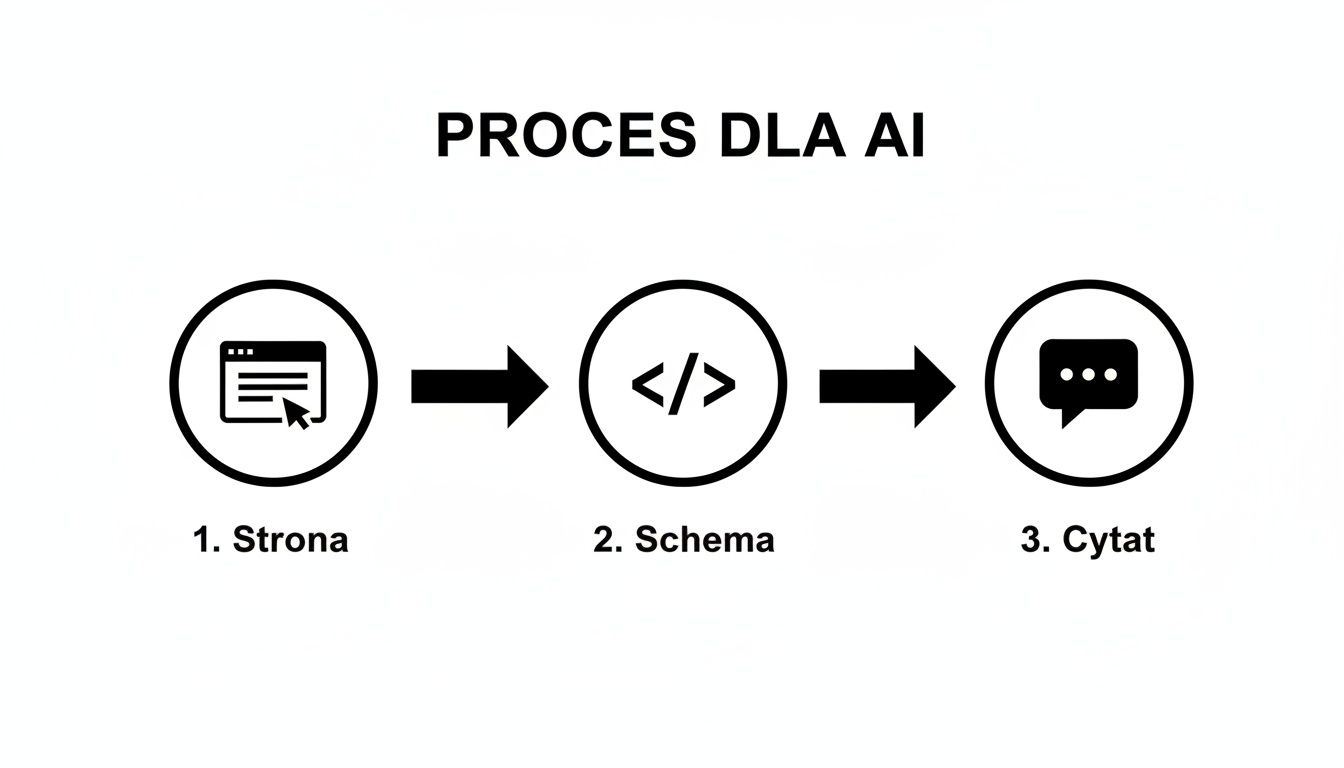

Schemat (Schema) to tłumacz, który przekłada zawartość strony na język zrozumiały dla maszyny. Dzięki niemu AI wie, co jest faktem, a co daną techniczną, co pozwala precyzyjnie wykorzystać Twoje treści.

Weryfikacja poprawności kodu

Po wdrożeniu musisz mieć pewność, że kod jest czysty. Błędy składniowe, jak brakujący przecinek, unieważniają cały znacznik. Najważniejszym narzędziem do weryfikacji jest Schema Markup Validator.

Schema Markup Validator to oficjalne narzędzie polecane przez twórców Schema.org. Wklejasz fragment kodu lub URL strony, a narzędzie pokazuje, czy dane są wolne od krytycznych błędów (

Errors) i czy nie brakuje im zalecanych pól (Warnings). Błędy uniemożliwiają odczytanie danych. Ostrzeżenia to sygnał, że warto coś uzupełnić.

Regularna walidacja to podstawa higieny technicznej. Dzięki niej masz pewność, że Twoje dane strukturalne dla crawlerów AI maksymalizują szansę na zrozumienie i zacytowanie. Prawidłowa optymalizacja treści pod AI Overviews to kolejny krok, który pozwala w pełni wykorzystać potencjał dobrze wdrożonych schematów.

Zarządzanie ruchem i budżetem crawlerów AI

Wdrożenie danych to jedno, ale równie ważne jest mądre zarządzanie tym, jak i kiedy boty AI odwiedzają Twoją stronę. Ruch generowany przez crawlery rośnie lawinowo, a z nim obciążenie i koszty serwerów.

Dane z 2026 roku pokazują, że crawlery AI generują już ponad 50% całego ruchu webowego w Polsce. Co gorsza, boty treningowe, takie jak GPTBot, potrafią zużywać nawet do 40% przepustowości serwerów, nie zawsze przynosząc natychmiastowe korzyści.

Podstawowym narzędziem staje się plik robots.txt, uzupełniony o standard llms.txt. Pozwalają one precyzyjnie kontrolować dostęp dla botów takich jak GPTBot, Google-Extended czy PerplexityBot.

Jak kontrolować boty AI

Za pomocą prostych dyrektyw możesz zablokować niechciane, zasobożerne boty, zostawiając otwarte drzwi dla tych, na których widoczności Ci zależy. Chodzi o to, by wizyty botów AI przekładały się na korzyści, a nie tylko koszty.

Przykładowe reguły w pliku robots.txt:

- Blokada GPTBot:

User-agent: GPTBotDisallow: / - Blokada Google-Extended:

User-agent: Google-ExtendedDisallow: /

Dane z polskiego rynku IT i turystyki pokazują, że firmy ze świadomym zarządzaniem crawlerami AI raportują dwukrotnie wyższą cytowalność w odpowiedziach generowanych przez LLM. To dowód, że świadome zarządzanie botami się opłaca.

Optymalizacja dla kluczowych crawlerów

Oczywiście, nie wszystkie boty warto blokować. Jeśli zależy Ci na widoczności w Gemini czy Perplexity, musisz zapewnić ich crawlerom swobodny dostęp. Decyzja, które boty wpuścić, a które zablokować, powinna być elementem szerszej strategii biznesowej. Ostatecznym celem jest znalezienie złotego środka między oszczędnością zasobów a maksymalizacją widoczności.

Świadome zarządzanie ruchem botów to dziś tak samo ważny element strategii, jak same dane strukturalne dla crawlerów AI. Aby zgłębić techniczne różnice, sprawdź porównanie robots.txt vs llms.txt dla AI.

Monitorowanie widoczności w AI i optymalizacja strategii

Wdrożenie danych strukturalnych to fundament. Prawdziwa praca zaczyna się później i polega na ciągłym monitorowaniu efektów oraz elastycznym dostosowywaniu strategii. Trzeba na bieżąco analizować, jak LLM-y interpretują Twoją markę.

Samo posiadanie poprawnych znaczników nie gwarantuje, że AI zacznie Cię polecać. Tradycyjne narzędzia analityczne nie dostarczają takich danych, dlatego konieczne jest sięgnięcie po specjalistyczne platformy.

Mierzenie widoczności w odpowiedziach LLM

Analityka w kontekście AI to więcej niż śledzenie pozycji. Liczy się, jak często i w jakim kontekście Twoja marka jest cytowana. Platformy analityczne, takie jak PromptEye, pozwalają śledzić wskaźniki, które mają realne znaczenie biznesowe.

Podstawowe metryki do monitorowania:

- Share of Voice w AI: Jaki procent odpowiedzi na kluczowe zapytania zawiera wzmiankę o Twojej marce w porównaniu do konkurencji.

- Sentyment wzmianek: Czy AI przedstawia Twoją firmę w pozytywnym, neutralnym czy negatywnym świetle.

- Analiza konkurencji: Kogo i dlaczego AI poleca zamiast Ciebie. Analiza strategii konkurentów pozwala zidentyfikować luki.

Analiza takiego dashboardu pozwala błyskawicznie ocenić, która marka dominuje w narracji AI i jak zmienia się ta dynamika.

Ciągły monitoring to system wczesnego ostrzegania. Wykrycie, że AI cytuje nieaktualne dane lub powołuje się na negatywne opinie, pozwala zareagować, zanim dezinformacja zaszkodzi reputacji marki.

Optymalizacja strategii w oparciu o dane

Dane z monitoringu to punkt wyjścia do inteligentnej optymalizacji. Zaawansowane systemy analityczne nie tylko pokazują, co się dzieje, ale dostarczają konkretnych rekomendacji. Analizując tysiące odpowiedzi AI, potrafią wskazać, które schematy są najczęściej wykorzystywane w Twojej branży.

Taki system może np. zasugerować rozbudowę sekcji FAQ na stronie produktu, bo konkurenci zyskują widoczność dzięki schematowi FAQPage. Może też zidentyfikować, że Twoje artykuły są rzadziej cytowane z powodu braku znacznika dateModified. Jeśli chcesz dowiedzieć się, jak ocenić szanse na bycie cytowanym, sprawdź czynniki wpływające na prawdopodobieństwo cytowania przez AI.

Podsumowując, dane strukturalne dla crawlerów AI to nie cel, lecz narzędzie. Dopiero połączenie ich wdrożenia z analityką i ciągłą optymalizacją pozwala budować trwałą przewagę konkurencyjną.

Kluczowe wnioski: Twój plan działania

Ignorowanie danych strukturalnych w 2026 roku to jak zamknięcie drzwi przed najważniejszymi klientami – crawlerami AI. Modele takie jak GPTBot potrzebują drogowskazów, a Schema.org to język, który rozumieją najlepiej. Bez tego Twoja marka staje się niewidzialna.

Chcesz szybkich efektów? Zacznij od podstaw:

Organization: Fundament tożsamości Twojej firmy.Article: Koniecznie z datą modyfikacji (dateModified).FAQPage/HowTo: Prosta droga do cytowań. Nasze analizy pokazują, że w Polsce stosuje je aż 81% witryn, które pojawiają się w odpowiedziach AI.

Samo wdrożenie to początek. Prawdziwą przewagę zdobywa się w ciągłej optymalizacji. Mierz swoją widoczność w AI, analizuj sentyment i patrz, co robią konkurenci. Dopiero z takimi danymi w ręku można podejmować świadome decyzje.

Skupienie się na wdrożeniu, priorytetach i stałym monitoringu to mapa drogowa do budowania widoczności w erze AI. To już nie jest kwestia wyboru – to warunek, by skutecznie konkurować.

Najczęstsze pytania o dane strukturalne dla AI (FAQ)

Czy dane strukturalne to nowe SEO? Czy zastąpią tradycyjne działania?

Nie. Dane strukturalne nie zastępują SEO, ale stają się jego kluczowym rozszerzeniem w erze AI – AEO (AI Engine Optimization). Klasyczne SEO (treść, linki) buduje fundament. Dane strukturalne działają poziom wyżej, dostarczając maszynom uporządkowanych informacji, które LLM-y mogą wykorzystać do generowania odpowiedzi. Bez solidnych podstaw SEO, crawlery AI mogą nigdy nie trafić na Twój content.

Ile czasu zajmuje wdrożenie i kiedy widać efekty?

Wdrożenie prostego schematu Organization to często kilka godzin. Bardziej złożone projekty, jak dynamiczne schematy Product dla e-commerce, mogą zająć kilka dni. Poprawność kodu sprawdzisz od razu. Na realne efekty – pojawienie się w odpowiedziach AI – trzeba poczekać od kilku dni do kilku tygodni, w zależności od częstotliwości odwiedzin crawlerów.

Jakie są najczęstsze błędy przy wdrażaniu Schema.org?

Najczęściej powtarzające się błędy to:

- Błędy składniowe w JSON-LD: Brakujący przecinek potrafi unieważnić cały znacznik.

- Schemat niedopasowany do treści: Np. implementacja schematu

Articlena stronie produktowej. - Niekompletne dane: Pomijanie kluczowych pól, jak

dateModifiedw artykule, osłabia sygnał. - Dane niewidoczne dla użytkownika: Umieszczanie w kodzie informacji, których nie ma w treści widocznej na stronie.

Kluczem do uniknięcia tych wpadek jest żelazna zasada: regularna walidacja kodu w oficjalnych narzędziach, jak Schema Markup Validator. Traktuj to jako podstawę higieny technicznej.

Zacznij monitorować i świadomie kształtować swoją widoczność w erze AI. Sprawdź, jak Twoja marka może zyskać przewagę w odpowiedziach generowanych przez modele językowe.